Qwen3-Coder阿里云编程大模型

访问我们的 Hugging Face 或 ModelScope 组织(点击上方链接),搜索名称以“Qwen3-Coder-”开头的检查点,就能找到所需的一切!尽情享受吧!

最新消息

🔥🔥🔥 Qwen3-Coder-30B-A3B-Instruct 已发布,更多信息请此处。

Qwen3-Coder: Agentic Coding in the World.

简介

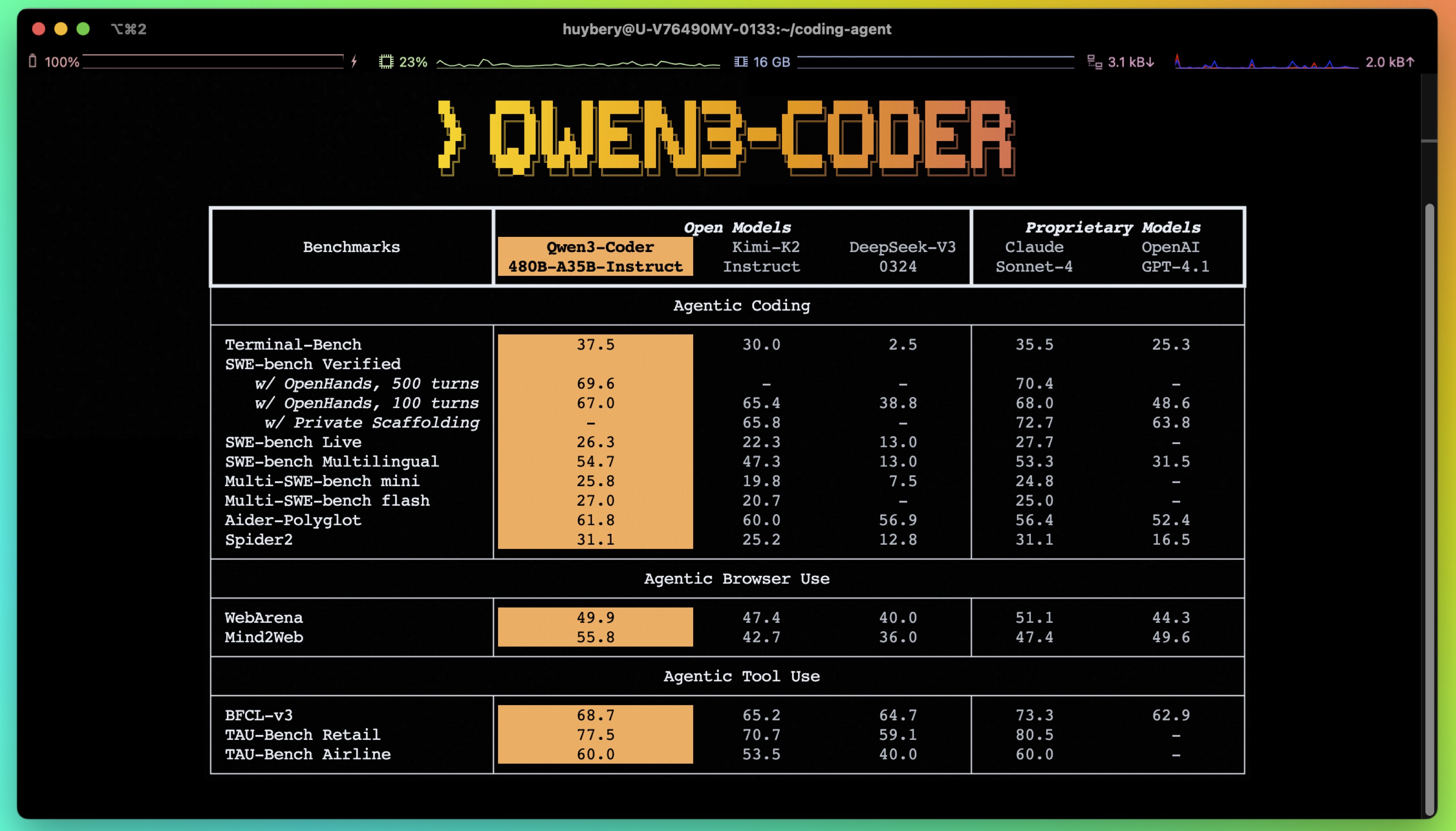

今天,我们隆重推出 Qwen3-Coder,这是我们迄今为止最具代理性的代码模型。Qwen3-Coder 提供多种版本,但我们首先要介绍的是其最强大的版本:Qwen3-Coder-480B-A35B-Instruct——一个拥有 480B 参数的混合专家模型,其中活跃参数为 35B,在编码和代理任务中均表现出色。Qwen3-Coder-480B-A35B-Instruct 在代理性编码、代理性浏览器使用和代理性工具使用方面,在开放模型中创下了新的最高纪录,堪比 Claude Sonnet。

💻 卓越的性能:在Agentic Coding、Agentic Browser-Use 和其他基础编码任务的开放模型中,取得了与 Claude Sonnet 相当的成果;

📚 长上下文能力:原生支持256K个 token,可使用 Yarn 扩展至1M个 token,并针对存储库规模的理解进行了优化;

🛠 Agentic Coding:支持大多数平台,例如Qwen Code、CLINE,并采用专门设计的函数调用格式;

基本信息

- ✨ 支持长上下文理解和生成,上下文长度可达 256K 个 token;

- ✨ 支持 358 种编码语言;

['ABAP', 'ActionScript', 'Ada', 'Agda', 'Alloy', 'ApacheConf', 'AppleScript', 'Arc', 'Arduino', 'AsciiDoc', 'AspectJ', 'Assembly', 'Augeas', 'AutoHotkey', 'AutoIt', 'Awk', 'Batchfile', 'Befunge', 'Bison', 'BitBake', 'BlitzBasic', 'BlitzMax', 'Bluespec', 'Boo', 'Brainfuck', 'Brightscript', 'Bro', 'C', 'C#', 'C++', 'C2hs Haskell', 'CLIPS', 'CMake', 'COBOL', 'CSS', 'CSV', "Cap'n Proto", 'CartoCSS', 'Ceylon', 'Chapel', 'ChucK', 'Cirru', 'Clarion', 'Clean', 'Click', 'Clojure', 'CoffeeScript', 'ColdFusion', 'ColdFusion CFC', 'Common Lisp', 'Component Pascal', 'Coq', 'Creole', 'Crystal', 'Csound', 'Cucumber', 'Cuda', 'Cycript', 'Cython', 'D', 'DIGITAL Command Language', 'DM', 'DNS Zone', 'Darcs Patch', 'Dart', 'Diff', 'Dockerfile', 'Dogescript', 'Dylan', 'E', 'ECL', 'Eagle', 'Ecere Projects', 'Eiffel', 'Elixir', 'Elm', 'Emacs Lisp', 'EmberScript', 'Erlang', 'F#', 'FLUX', 'FORTRAN', 'Factor', 'Fancy', 'Fantom', 'Forth', 'FreeMarker', 'G-code', 'GAMS', 'GAP', 'GAS', 'GDScript', 'GLSL', 'Genshi', 'Gentoo Ebuild', 'Gentoo Eclass', 'Gettext Catalog', 'Glyph', 'Gnuplot', 'Go', 'Golo', 'Gosu', 'Grace', 'Gradle', 'Grammatical Framework', 'GraphQL', 'Graphviz (DOT)', 'Groff', 'Groovy', 'Groovy Server Pages', 'HCL', 'HLSL', 'HTML', 'HTML+Django', 'HTML+EEX', 'HTML+ERB', 'HTML+PHP', 'HTTP', 'Haml', 'Handlebars', 'Harbour', 'Haskell', 'Haxe', 'Hy', 'IDL', 'IGOR Pro', 'INI', 'IRC log', 'Idris', 'Inform 7', 'Inno Setup', 'Io', 'Ioke', 'Isabelle', 'J', 'JFlex', 'JSON', 'JSON5', 'JSONLD', 'JSONiq', 'JSX', 'Jade', 'Jasmin', 'Java', 'Java Server Pages', 'JavaScript', 'Julia', 'Jupyter Notebook', 'KRL', 'KiCad', 'Kit', 'Kotlin', 'LFE', 'LLVM', 'LOLCODE', 'LSL', 'LabVIEW', 'Lasso', 'Latte', 'Lean', 'Less', 'Lex', 'LilyPond', 'Linker Script', 'Liquid', 'Literate Agda', 'Literate CoffeeScript', 'Literate Haskell', 'LiveScript', 'Logos', 'Logtalk', 'LookML', 'Lua', 'M', 'M4', 'MAXScript', 'MTML', 'MUF', 'Makefile', 'Mako', 'Maple', 'Markdown', 'Mask', 'Mathematica', 'Matlab', 'Max', 'MediaWiki', 'Metal', 'MiniD', 'Mirah', 'Modelica', 'Module Management System', 'Monkey', 'MoonScript', 'Myghty', 'NSIS', 'NetLinx', 'NetLogo', 'Nginx', 'Nimrod', 'Ninja', 'Nit', 'Nix', 'Nu', 'NumPy', 'OCaml', 'ObjDump', 'Objective-C++', 'Objective-J', 'Octave', 'Omgrofl', 'Opa', 'Opal', 'OpenCL', 'OpenEdge ABL', 'OpenSCAD', 'Org', 'Ox', 'Oxygene', 'Oz', 'PAWN', 'PHP', 'POV-Ray SDL', 'Pan', 'Papyrus', 'Parrot', 'Parrot Assembly', 'Parrot Internal Representation', 'Pascal', 'Perl', 'Perl6', 'Pickle', 'PigLatin', 'Pike', 'Pod', 'PogoScript', 'Pony', 'PostScript', 'PowerShell', 'Processing', 'Prolog', 'Propeller Spin', 'Protocol Buffer', 'Public Key', 'Pure Data', 'PureBasic', 'PureScript', 'Python', 'Python traceback', 'QML', 'QMake', 'R', 'RAML', 'RDoc', 'REALbasic', 'RHTML', 'RMarkdown', 'Racket', 'Ragel in Ruby Host', 'Raw token data', 'Rebol', 'Red', 'Redcode', "Ren'Py", 'RenderScript', 'RobotFramework', 'Rouge', 'Ruby', 'Rust', 'SAS', 'SCSS', 'SMT', 'SPARQL', 'SQF', 'SQL', 'STON', 'SVG', 'Sage', 'SaltStack', 'Sass', 'Scala', 'Scaml', 'Scheme', 'Scilab', 'Self', 'Shell', 'ShellSession', 'Shen', 'Slash', 'Slim', 'Smali', 'Smalltalk', 'Smarty', 'Solidity', 'SourcePawn', 'Squirrel', 'Stan', 'Standard ML', 'Stata', 'Stylus', 'SuperCollider', 'Swift', 'SystemVerilog', 'TOML', 'TXL', 'Tcl', 'Tcsh', 'TeX', 'Tea', 'Text', 'Textile', 'Thrift', 'Turing', 'Turtle', 'Twig', 'TypeScript', 'Unified Parallel C', 'Unity3D Asset', 'Uno', 'UnrealScript', 'UrWeb', 'VCL', 'VHDL', 'Vala', 'Verilog', 'VimL', 'Visual Basic', 'Volt', 'Vue', 'Web Ontology Language', 'WebAssembly', 'WebIDL', 'X10', 'XC', 'XML', 'XPages', 'XProc', 'XQuery', 'XS', 'XSLT', 'Xojo', 'Xtend', 'YAML', 'YANG', 'Yacc', 'Zephir', 'Zig', 'Zimpl', 'desktop', 'eC', 'edn', 'fish', 'mupad', 'nesC', 'ooc', 'reStructuredText', 'wisp', 'xBase']3.✨ 保留基础模型的数学和一般能力的优势。

[!重要]

Qwen3-coder 函数调用依赖于我们新的工具解析器

qwen3coder_tool_parser.py此处。我们更新了特殊 token 及其对应的 token ID,以与 Qwen3 保持一致。请确保使用新的 token 生成器。

| 模型名称 | 类型 | 长度 | 下载 |

|---|---|---|---|

| Qwen3-Coder-480B-A35B-Instruct | instruct | 256k | 🤗 拥抱脸 • 🤖 模型范围 |

| Qwen3-Coder-480B-A35B-Instruct-FP8 | 指示 | 256k | 🤗 拥抱脸 • 🤖 模型范围 |

| Qwen3-Coder-30B-A3B-Instruct | 指示 | 256k | 🤗 拥抱脸 • 🤖 模型范围 |

| Qwen3-Coder-30B-A3B-Instruct-FP8 | 指示 | 256k | 🤗 拥抱脸 • 🤖 模型范围 |

详细的性能和介绍请参见这篇 📑 博客。

快速入门

[!重要]

Qwen3-Coder-480B-A35B-Instruct 是用于聊天的指令模型;此模型仅支持非思考模式,并且不会在输出中生成

<think></think>块。同时,不再需要指定enable_thinking=False。**

👉🏻 使用 Qwen3-Coder 聊天

您只需编写几行带有 transformers 的代码即可使用 Qwen3-Coder-480B-A35B-Instruct 进行聊天。本质上,我们使用 from_pretrained 方法构建分词器和模型,并使用 generate 方法借助分词器提供的聊天模板执行聊天。以下是如何使用 Qwen3-Coder-480B-A35B-Instruct 进行聊天的示例:

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "Qwen/Qwen3-Coder-480B-A35B-Instruct"

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype="auto",

device_map="auto"

)

tokenizer = AutoTokenizer.from_pretrained(model_name)

prompt = "write a quick sort algorithm."

messages = [

{"role": "user", "content": prompt}

]

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True

)

model_inputs = tokenizer([text], return_tensors="pt").to(model.device)

generated_ids = model.generate(

**model_inputs,

max_new_tokens=65536

)

generated_ids = [

output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids)

]

response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0]apply_chat_template() 函数用于将消息转换为模型可以理解的格式。

add_generation_prompt 参数用于添加生成提示,该提示指向输入中的 <|im_start|>assistant\n。值得注意的是,我们按照之前的惯例,将 ChatML 模板应用于聊天模型。

max_new_tokens 参数用于设置响应的最大长度。tokenizer.batch_decode() 函数用于解码响应。就输入而言,上述消息是一个示例,展示了如何格式化对话历史记录和系统提示。

您可以按照相同的方式使用其他大小的 instruct 模型。